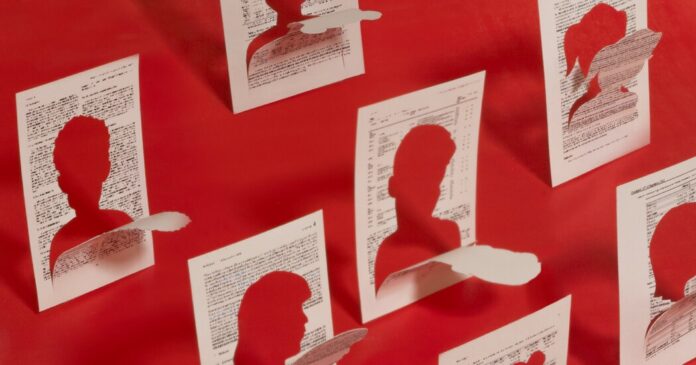

I ricercatori hanno avuto accesso illegalmente ai dati genetici e cognitivi di oltre 20.000 bambini statunitensi che partecipavano a un importante studio finanziato dal governo federale, il progetto Adolescent Brain Cognitive Development (ABCD), e li hanno utilizzati per produrre articoli pseudoscientifici che promuovevano gli stereotipi razziali.

Lo studio e la sua promessa

Lanciato nel 2015, il progetto ABCD mirava a monitorare lo sviluppo del cervello nei bambini per un decennio, promettendo alle famiglie che i loro dati sarebbero stati protetti in modo sicuro. Lo studio mirava a comprendere in che modo la genetica influenza il comportamento e le malattie, e i materiali di marketing rassicuravano specificamente le famiglie appartenenti a minoranze sulla privacy dei dati.

Accesso non autorizzato ai dati

Nonostante queste assicurazioni, un gruppo di ricercatori marginali ha sfruttato le vulnerabilità nelle misure di sicurezza del National Institutes of Health (NIH) per ottenere accesso non autorizzato ai dati sensibili. Un ricercatore ha aggirato le restrizioni lavorando con un professore americano già sotto indagine del NIH per aver gestito male un altro studio sul cervello di un bambino.

Uso improprio razzista dei risultati

Il gruppo ha poi pubblicato almeno 16 articoli in cui affermava di aver trovato prove biologiche a sostegno delle differenze razziali nell’intelligenza. Questi documenti classificano le etnie in base a presunti punteggi di QI e affermano falsamente che i guadagni inferiori tra i neri sono dovuti a un’intrinseca inferiorità cognitiva.

Questo lavoro è stato ampiamente rifiutato dai genetisti tradizionali in quanto parziale e metodologicamente infondato. Tuttavia, l’uso da parte dei ricercatori dei dati del rispettato progetto ABCD ha dato alle loro teorie una falsa patina di legittimità scientifica.

Amplificazione attraverso i social media e l’intelligenza artificiale

I giornali hanno alimentato contenuti razzisti sulle piattaforme dei social media e sui forum nazionalisti bianchi, raccogliendo milioni di visualizzazioni. In modo inquietante, i chatbot basati sull’intelligenza artificiale come ChatGPT e Grok hanno citato questa ricerca in risposta a domande su razza e intelligenza, diffondendo ulteriormente la disinformazione. Grok, in particolare, ha indirizzato gli utenti a questi giornali più di due dozzine di volte questo mese.

Questo incidente evidenzia i gravi rischi di violazione dei dati in progetti di ricerca su larga scala e il potenziale che i dati scientifici possano essere utilizzati come armi per ideologie dannose. Lo sfruttamento delle informazioni genetiche dei bambini sottolinea l’urgente necessità di misure di sicurezza dei dati più forti e di un controllo etico nella ricerca scientifica.